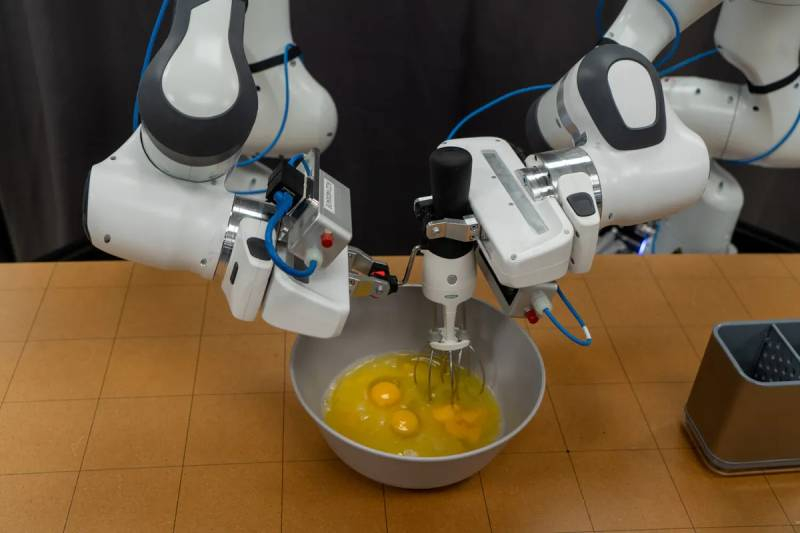

Toyota научила роботов готовить завтраки, просто показав, как это делать

В исследовательском институте Toyota (TRI) с помощью генеративного искусственного интеллекта обучили роботов некоторым навыкам приготовления завтрака. И это не потребовало сотен часов программирования и дальнейшей работы над ошибками и исправлением их. Вместо этого исследователи оснастили роботов специальными датчиками, обеспечивающими чувство осязания, подключили их к модели искусственного интеллекта, а затем показали системе, что нужно делать, пишет The Verge.

Исследователи отметили, что осязание является «одним из ключевых факторов» в обучении. Благодаря осязанию робот может «чувствовать», что он делает, получая больше информации. Это облегчает выполнение сложных задач по сравнению с использованием только одних камер.

По словам сотрудника лаборатории TRI Бена Берчфилда (Ben Burchfiel), «интересно видеть, как они (роботы) взаимодействуют с окружающей средой». Сначала «учитель» демонстрирует набор навыков, а затем «в течение нескольких часов» модель учится в фоновом режиме. «Мы обычно обучаем робота днём, позволяем ему учиться всю ночь, а на следующее утро приступаем к новому рабочему поведению», — пояснил Берчфилд.

Исследователи рассказали, что они пытаются создать так называемые «большие модели поведения» (Large Behavior Models, LBM). Подобно тому, как большие языковые модели (LLM) обучаются, отмечая закономерности в тексте, модели LBM Toyota учатся путём наблюдения, а затем «обобщают, применяя новый навык, которому их никогда не учили», говорит Расс Тедрейк (Russ Tedrake), профессор робототехники Массачусетского технологического института и вице-президент по исследованиям в области робототехники TRI. Используя этот метод, исследователи научили роботов более чем 60 сложным навыкам, таким как «разлив жидкостей, использование инструментов и манипулирование деформируемыми объектами». Исследователи TRI планируют обучить роботов к концу 2024 года до 1000 навыков.

В аналогичном направлении работает Google, создавшая ИИ-модель RT-2 (Robotics Transformer 2) класса «зрение-язык-действие» (Vision-Language-Action — VLA). Подобно разработке Toyota, роботы на базе RT-2 используют полученный опыт, чтобы делать выводы, как действовать. Теоретически, роботы, обученные искусственным интеллектом, смогут в конечном итоге выполнять задачи практически без каких-либо инструкций, кроме общих указаний, которые обычно дают человеку, например, «очистить пол от пятна».

Как отметила The New York Times, такого рода работа (создание модели подобной RT) обычно «медленная и трудоёмкая», и предоставить достаточное количество обучающих данных гораздо сложнее, чем просто передать в модель ИИ массу данных, которые можно скачать из интернета.